NINO y GIGO (Nothing in, Nothing Out, Gargabe in, Garbage Out). Estos dos paradigmas son mucho más ilustrativos de lo que parecen. Aquí es donde yo suelo hablar del concepto «dato relevante«. El primero de ellos, básicamente refleja una realidad en la que por mucho que tengamos un gran modelo o herramienta, si los datos de entrada, no son buenos, no podremos hacer nada. Y lo mismo, si los datos de entrada no son de buena calidad.

Es por ello que creo en ocasiones es bueno hablar de las expectativas que el Big Data ha venido a generar, y lo que luego efectivamente se ha convertido en realidad. Se han generado estos año muchas expectativas con Google y Facebook y lo que supuestamente saben de nosotros. Saben más que el resto, sin duda. Pero, suavicemos el discurso. No saben todo.

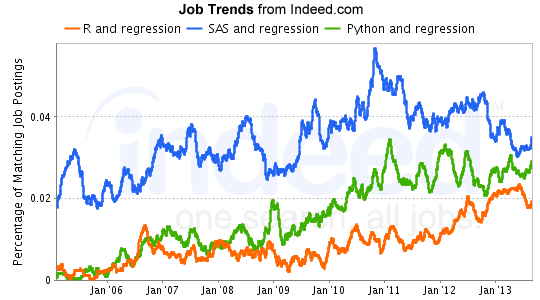

¿Por qué? Pues porque el concepto de «dato relevante» no siempre es alcanzado. Fijense en la siguiente representación gráfica:

Como se puede apreciar los datos más relevantes están alejados de lo que hoy todavía las empresas disponen. Incluso en las grandes empresas tecnológicas de Internet. La horquilla tradicional de datos relevantes/datos totales se mueve entre el 10% y el 15%. Las empresas disponen de muchos datos demográficos (si se fijan, sobre los que pivotan la gran mayoría de noticias), pero apenas saben nada sobre nuestras actitudes o necesidades, por ejemplo. Se aproximan con modelos sencillos. De ahí, que muchas de las expectativas que se han venido generando con el «Big Data», luego las tratas de aterrizar, y se vuelven complicadas.

No es lo mismo los datos demográficos, que los sociológicos, de comportamiento, de actitud o de necesidades. El valor incrementa con el orden en la frase anterior. Pero normalmente construimos discursos alrededor de datos demográficos. Que tienen valor, vaya, pero no el que tienen los de actitud o necesidades.

En este punto hay que hablar de lo que se denomina «First-Party Data» y «Third-Party Data». Las fuentes «First-Party» son aquellas que son propias de las empresas. Entre ellas, destacan:

Ahora mismo la explotación de estos datos está siendo limitada por la sencilla razón de no disponer de un único punto central que integra y permite la explotación de datos centralizada. Aquí es donde cobra sentido el concepto de «data lake«, por cierto.

Por otro lado, los «Third-Party Data», son aquellos datos que compramos a «mayoristas» o «proveedores» de datos. Datos relacionados con el consumo, estilo de vida, demografía, comportamiento en tiempo real, etc. Permiten completar la «foto» a una empresa. Ya hablamos en cierto modo de los problemas que entrañaba para la privacidad de un sujeto estas transacciones de datos. En este caso, las limitaciones de las empresas parecen venir desde la óptica de la calidad de datos: frescura, precisión, etc., problemas ligados a la calidad de datos de lo que ya hemos hablado en el pasado.

Las empresas, ante la limitación que suelen tener de explotar sus «First-Party Data«, deberían comenzar a mirar hacia los «Third-Party Data» si quieren enriquecer muchos sus modelos y hacer más más precisos sus modelos. La capacidad de generar valor a partir del análisis de datos necesita de integrar nuevas fuentes de datos. Porque los datos que son más importantes no quedan recogidos en las operaciones diarias de una empresa.

Y es que el paradigma del «Big Data» es un medio, no un fin. Es un instrumento del que podemos valernos para obtener conclusiones. Pero el valor de los mismos, dependerá en gran medida de la materia prima con la que trabajemos. Y por ello, muchos de los fines están todavía por inventar. De ahí que suela decir que no hay dos proyectos de Big Data iguales; depende mucho de cómo las empresas vayan avanzando desde sus datos demográficos a los datos de actitud. De sus datos propios («First-Party Data«) a integrar también datos de terceros («Third-Party Data«).

Creo que muchas de las expectativas no alcanzadas aún hoy se deben a que seguimos viendo este campo del análisis de datos como el «Data Mining original«. Aquel en el que el objetivo era explotar grandes conjuntos de datos. Que no digo que esto no siga siendo válido; pero si queremos alcanzar las grandes expectativas generadas, debemos mirar «más allá». Y entender el valor que tienen los datos que nos pueden aportar los datos de terceros o los «Open Data«, me resulta bastante crítico. Y así, poder alcanzar mejor las expectativas para hacerlas reales.