Cajamar UniversityHack, la competición de analítica de datos más grande de España, celebra su edición de 2018 con Deusto entre los 20 centros seleccionados para participar! Deusto BigData sigue creciendo!

¿Qué es? Cajamar UniversityHack 2018 es un evento dirigido específicamente a los alumnos de los mejores centros formativos en Data Science de España. Para poder participar, deberás haber sido estudiante de alguno de nuestros Programas de Big Data (www.bigdata.deusto.es) en el curso 2016/17 y en la 2017/18.

Las inscripciones se abrirán a mediados de enero. La competición tendrá lugar del 31 de enero al 12 de abril de 2018. Máximo podrán participar 3 personas por cada equipo de Deusto (y resto de centros, claro). Como sospecho os querréis apuntar unos cuantos equipos, he preparado este formulario para que podamos luego entre todos determinar cuántos sois, y qué criterio justo aplicar en caso de que seais más de 10. En primer lugar, vamos a abrir el proceso de registro, y luego vemos si es necesario aplicar algún criterio justo. Os anticipamos, y pedimos, que en la medida de lo posible, os presentéis en parejas o tríos, para facilitar el mayor número de participantes. El formulario, como digo, lo podéis encontrar aquí. Tenéis hasta el 20 de enero para apuntaros, para que tengamos luego desde el 20 al 29 para poder registraros a todos y todas.

Tenéis tiempo aún, por lo que dedicar un rato a formar los equipos, hablar con posibles tutores, definir el enfoque del proyecto, etc.

Para participar, se podrán afrontar dos retos:

- Wefferent Card Analytics: crear una aplicación y/o visualización autoconsumible usando datos anonimizados de transacciones con tarjeta en la ciudad de Murcia, con una selección de datos reales agregados del Grupo Cajamar entre los años 2015 y 2017. Puedes realizar un cuadro de mando, un ejercicio analítico exploratorio, una infografía, una web, un análisis gráfico avanzado, etc.

- Salesforce Predictive Modelling: el poder adquisitivo de un cliente es uno de los ejes principales en el consumo de productos financieros siendo una variable crítica y de difícil cálculo. Uno de los retos a los que se enfrentan las empresas es predecir esta variable de cara a establecer segmentaciones estratégicas más eficientes que les ayuden en la toma de decisiones a la hora de ofrecer el producto más adecuado en cada momento a cada persona, según las necesidades de cada cliente. En este desafío dispondrás de 90 características anónimas que te permitirán estimar y predecir la renta de cada cliente.

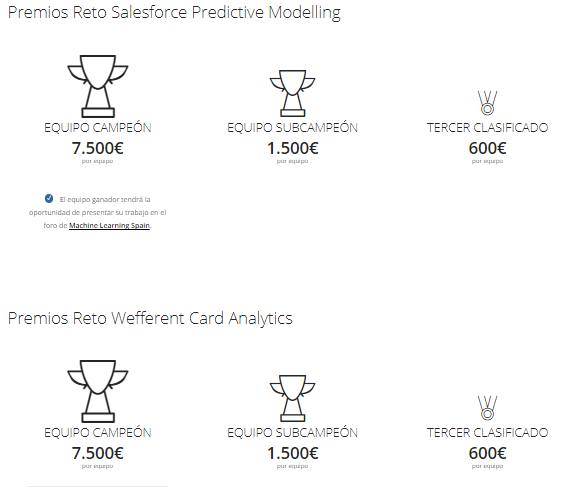

¿Cuáles son los premios? Más allá del desarrollo de habilidades científicas y participar en un reto a nivel de todo el país, ya buenos premios. Además, el equipo ganador tendrá la oportunidad de presentar su trabajo en el Machine Learning Spain. Todos los detalles, los podéis encontrar aquí.

Además, solo por participar, tendrás estos beneficios:

- Cada participante recibirá el exclusivo welcome pack de nuestros patrocinadores.

- Un mes de suscripción con acceso ilimitado a todos los cursos especializados (Python, R, SQL, Git, Shell y mucho más) de la plataforma de formación online DataCamp.

- Un libro electrónico a elegir sobre una selección de publicaciones de la prestigiosa O’Reilly Media.

El calendario de fases e hitos, lo podéis consultar aquí. Hitos que se pueden resumir en los siguientes:

- Periodo de inscripción: del 15 al 29 de enero de 2018

- Confirmación de equipos participantes: 30 de enero 2018

- Fase 1 (en Deusto)

- Primera Fase del Concurso: del 31 de enero al 21 de febrero de 2018

- Fallo del jurado local: 1 de marzo de 2018

- Fase 2 (para todo España)

- Segunda Fase del Concurso: del 1 de marzo al 14 de marzo de 2018

- Selección de mejores trabajos: 27 de marzo de 2018

- Presentación de mejores trabajos y fallo del jurado nacional: 12 de abril de 2018

Anímate, y que Deusto BigData sea ganador de estos premios del Cajamar UniversityHack 2018! Os agradecería si pudieráis compartirlo con todos nuestros estudiantes de los cursos 2016/17 y 2017/18 para que nadie se quede fuera de esta magnífica oportunidad.