Watson, un sistema inteligente desarrollado por IBM, se hizo popular cuando se presentó al concurso Jeopardy y ganó a los dos mejores concursantes de la historia del programa. Es un programa basado en el «formato trivial«: programas que requieren de unas preguntas, y un conjunto de respuestas cerradas. Watson, con una capacidad descomunal para replicar muchas de las singularidades de los humanos (formulación de hipótesis, búsqueda de evidencias, comparación de posibles respuestas, selección de la mejor respuesta en base a diferentes parámetros, tratamiento de información no estructurada, etc.), dejó al mundo a la puerta de los nuevos sistemas basados en grandes cantidades de datos.

Pero esta herramienta no fue diseñada y desarrollada para ganar concursos televisivos. Llegó para aportar valor en diferentes sectores y actividades económicas. Primero, fue el sector sanitario, que es el que nos va a ocupar hoy en este recorrido por las posibilidades que trae el Big Data y el Business Intelligence.

Watson fue solicitada por la empresa de servicios sanitarios WellPoint y el Memorial Sloan-Kettering Cancer Center para proporcionar servicios de diagnóstico. Es decir, ayudar en una de las tareas más singulares del ser humano: detectar problemas. Watson pronto comenzó a mostrar sus resultados. Mejoró la predicción desde un 50% hasta el 90%.

Watson aporta al campo sanitario muchas ventajas. Especialmente, porque a un servicio y profesión como las del ámbito sanitario, viene muy bien el disponer de muchos datos de evidencias pasadas, casos parecidos (misma tupla «pregunta»-«respuesta»), lectura de conocimiento no estructurada (artículos científicos sobre evidencias para la cura de enfermedades, etc.) Y es que al final, la decisión sobre el mejor tratamiento es una mezcla de todas esas capacidades.

Presentado este contexto con Watson, podríamos así preguntarnos: ¿cómo ha cambiado entonces el mundo sanitario gracias al Big Data? Pues de manera considerable. Especialmente, por la eficiencia que aporta a los sistemas de salud a la hora de la presentación del servicio al paciente (obviamente lo más importante), tanto en términos de eficiencia como de buen resultado.

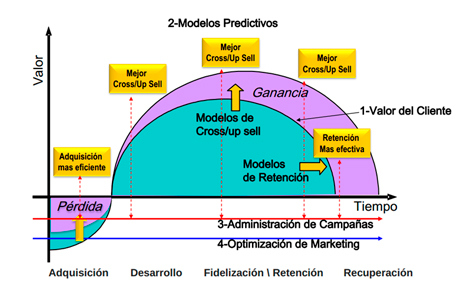

En la cadena de valor de los sistemas sanitarios, al final, hay muchos agentes a los que esta gran cantidad de datos les podría aportar mucho valor en su día a día:

Pacientes, gestores, proveedores de servicios auxiliares y, como no, los cuidadores (médicos, cirujanos, enfermeros, etc.), podrían beneficiarse de la eficiencia y ventajas que trae obtener insights de los datos. Aquí es donde varios expertos de la materia hablan de la futura Medicina 5P, el cruce entre la sanidad y Big Data:

- Personalizada: el eterno sueño de la medicina. Poder dar un tratamiento singular al diagnóstico y necesidades concretas de cada uno de los pacientes. Con el Big Data, la cantidad ingente de datos, y el contexto que describe a cada uno de los pacientes, esto es posible. Solo es cuestión de «codificar» en datos lo que hasta ahora no hemos hecho, en cuestión de aspectos clínicos como estado de ánimo, emociones, expresión del dolor, etc.

- Predictiva: se trataría de pasar de un modelo reactivo de sanidad a otro modelo activo y predictivo mucho más eficiente en el que el sistema sanitario y sus cuidadores, advierte directamente al paciente de situaciones potencialmente peligrosas. La estadística al servicio de nuestra salud.

- Preventiva: se trataría de prevenir la aparición de enfermedades, basada en un conjunto de actuaciones médicas y el análisis de patrones y datos históricos. Ya sabemos esa máxima de «Es mejor prevenir que lamentar», que en medicina cobra más sentido que en cualquier otra área de la vida.

- Participativa: la importancia que todos los agentes de los que hemos hablado anteriormente estén bien coordinados. El trabajo con pacientes no solamente tiene impacto en los aspectos terapéuticos, sino también en la gestión y los procesos, de manera que no escape detalle alguno (esto en España, donde tenemos una fragmentación de la organización del Sistema Sanitario importante, con 17 sistemas, vendría realmente bien).

- Poblacional: para toda la población. La posibilidad de hacer más eficiente el sistema podría traer que con los mismos recursos, pudiéramos atender a un mayor volumen de población. En definitiva, no dejar a nadie sin atención.

Tampoco esta labor será sencilla. Mucho del conocimiento sanitario se encuentra expresado en fuentes no estructuradas. Es decir, sin ningún tipo de estructuración en matrices de datos. Las tecnologías para procesar este conocimiento es bastante más complicada y costosa que la que procesa datos estructurados.

Por otro lado, mucho de los tratamientos sanitarios funcionan en un contexto dado, pero no en otros. Esto hace que la codificación en datos de este contexto resulte vital. Y a su vez, genera más complejidad tanto de generación y gestión de datos, como de procesamiento y posterior puesta en valor. Además, la complejidad de los datos (desde los genóminos, pasando por biomarcadores, así como aspectos de índoles social) es importante. Su organización, vital para sacarle valor a los datos.

Como suele ocurrir con el Big Data, esto no está exento de riesgos. La recogida de los datos de comportamiento de los pacientes con sensores, genera datos. ¿Y dónde quedan? ¿Y de quién son? Son aspectos que, como suele ocurrir, la ley aún no contempla. Es algo que en anteriores ocasiones ya he comentado. Los aspectos sociales y de comunicación resultan críticos aquí. No debemos olvidar los aspectos de privacidad entonces. Y por último, el «profiling» de clientes y las posibilidades de toma de decisiones ajenas a la ética que trae. ¿No atenderé a un cliente que a tenor de los datos está en un riesgo alto? ¿No cubriré con una póliza de seguro a una persona con muchas probabilidades de fallecer? Pueden resultar cuestiones obvias, pero no está de menos sacarlas.

Ya ven que son muchos sectores los que traen posibilidades y retos con el Big Data. El campo sanitario no es esquivo a ello. La sanidad y Big Data de la mano para una mejor sociedad y bienestar de todos.